DeepSeek heeft bewezen dat AI-training niet de duurste GPU’s zoals de H100 nodig heeft. In plaats daarvan kunnen bedrijven hoge prestaties behalen tegen lagere kosten met gereviseerde NVIDIA A100-, V100- of H800-GPU’s.

Kostenbesparende AI met NVIDIA A100- en V100-GPU’s

Kunstmatige intelligentie ontwikkelt zich razendsnel en bedrijven wereldwijd zoeken naar manieren om AI-infrastructuur op te bouwen zonder te veel uit te geven. Het succes van DeepSeek, een Chinees AI-bedrijf, heeft aangetoond dat geavanceerde AI niet de nieuwste of duurste GPU’s vereist, maar eerder de juiste hardwarekeuze.

Zo werd ChatGPT getraind met NVIDIA's V100- en A100-GPU’s, terwijl DeepSeek ongeveer 2.000 NVIDIA H800-GPU’s gebruikte, een model dat speciaal voor China is ontworpen met een lagere chip-naar-chip bandbreedte vergeleken met de wereldwijde variant, de H100.

Hoewel de A100 en V100 oudere generatie modellen zijn, blijven ze uiterst geschikt voor AI-training en inferentie. Dit markeert een belangrijke verschuiving: bedrijven kunnen krachtige AI-prestaties bereiken met kosteneffectieve opties zoals A100 en V100 in plaats van te investeren in de nieuwste, dure GPU’s.

Wat is DeepSeek?

DeepSeek is een Chinees AI-bedrijf dat wereldwijde aandacht heeft getrokken door een AI-model te ontwikkelen dat mogelijk kan concurreren met ChatGPT van OpenAI, maar tegen aanzienlijk lagere kosten. In tegenstelling tot Amerikaanse AI-giganten die miljarden investeren in infrastructuur, beweert DeepSeek zijn AI te hebben getraind met slechts 2.000 NVIDIA H800-GPU’s, wat bewijst dat krachtige AI geen extreem dure hardware vereist.

Deze aanpak positioneert DeepSeek als een kostenefficiënt alternatief in AI-ontwikkeling en daagt de heersende opvatting uit dat geavanceerde AI enorme financiële investeringen vereist.

Wie is de eigenaar van DeepSeek?

DeepSeek werd in juli 2023 opgericht door Liang Wenfeng, een afgestudeerde van Zhejiang University met een achtergrond in AI-gestuurde investeringsstrategieën. Zijn hedgefonds, High-Flyer, zorgde voor de financiële steun en hij bezit 84 procent van het bedrijf via twee schijnvennootschappen.

De opkomst van DeepSeek betekent een verschuiving in AI-ontwikkeling en toont aan dat AI-modellen efficiënt kunnen worden getraind zonder miljardeninvesteringen, wat mogelijk de manier waarop bedrijven in AI investeren kan veranderen.

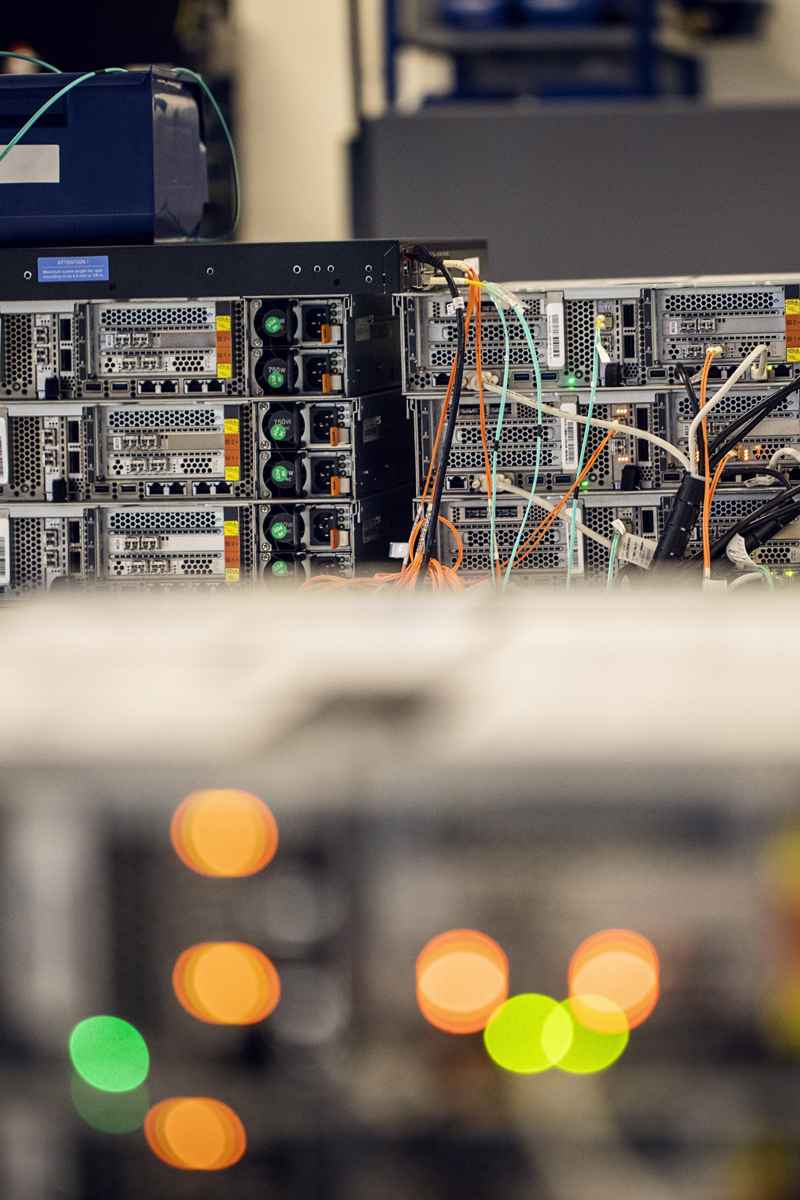

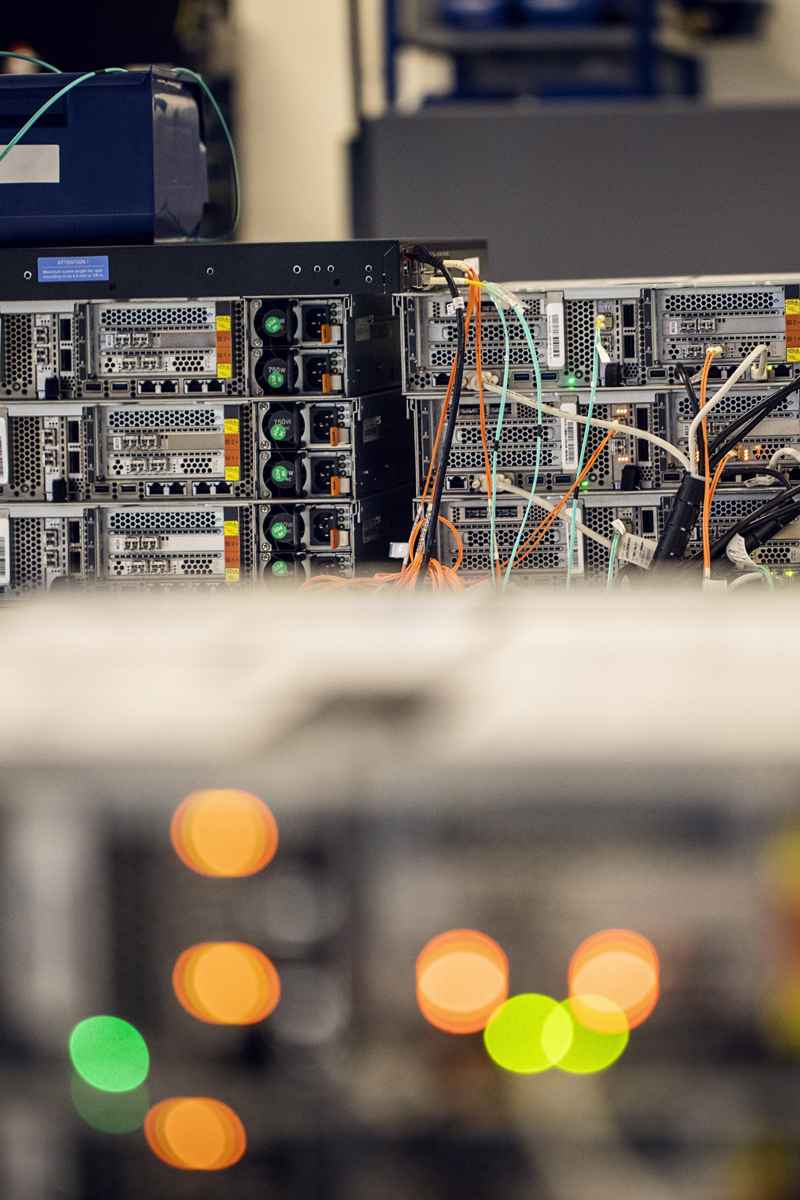

AI-servers bouwen tegen lagere kosten met gereviseerde NVIDIA A100-GPU’s

Naarmate AI steeds vaker wordt toegepast, heroverwegen bedrijven hun hardwarestrategieën. In plaats van miljoenen uit te geven aan de nieuwste GPU’s, kiezen veel bedrijven voor gereviseerde NVIDIA A100-GPU’s om hun AI-infrastructuur op te schalen tegen een fractie van de kosten.

Buiten China is de A100 het beste alternatief voor de H800, met vergelijkbare AI-trainingscapaciteiten en betere wereldwijde beschikbaarheid. Hoewel de V100 een solide keuze blijft voor inferentie, biedt de A100 betere efficiëntie, schaalbaarheid en geheugenbandbreedte voor moderne AI-toepassingen.

De H100 is de krachtigste optie, maar de A100 biedt de beste balans tussen kosten en prestaties voor bedrijven die hun AI-investeringen willen optimaliseren.

Waarom kiezen voor gereviseerde A100-GPU’s?

✔ Tot 70 procent besparing – AI-prestaties op ondernemingsniveau tegen lagere kosten

✔ Duurzaam en efficiënt – Verlengt de levensduur van de GPU en verlaagt IT-kosten

✔ Geoptimaliseerd voor AI – Ideaal voor deep learning en grote taalmodellen (LLM’s)

Lagere kosten, maximale prestaties

De hoge kosten van nieuwe hardware beperken de adoptie van AI, maar gereviseerde A100-GPU’s bieden enorme verwerkingskracht voor deep learning, modeltraining en real-time AI-toepassingen, waardoor bedrijven concurrerend blijven.

Naast kostenbesparingen zorgen gereviseerde GPU’s ervoor dat bedrijven kapitaal kunnen vrijmaken voor AI-onderzoek, data-optimalisatie en softwareontwikkeling, waardoor innovatie wordt versneld zonder financiële flexibiliteit op te offeren.

De NVIDIA H100 is de krachtigste GPU voor AI-werkbelastingen, maar heeft een aanzienlijk hogere prijs. De A100 daarentegen biedt de beste prijs-prestatieverhouding, waardoor het de ideale keuze is voor bedrijven die behoefte hebben aan snelle AI-training zonder de hoge kosten van een H100-upgrade.

Hoe verhoudt de NVIDIA A100 zich tot de H800?

De H800 is een variant van de H100 die specifiek voor de Chinese markt is ontwikkeld. Deze GPU heeft een verlaagde NVLink-bandbreedte en een lager algeheel prestatieniveau vanwege exportbeperkingen vanuit de Verenigde Staten. Hoewel de H800 sterke AI-capaciteiten biedt, is deze niet beschikbaar voor bedrijven buiten China, waardoor een alternatief nodig is.

Voor bedrijven buiten China is de A100 het beste alternatief voor de H800, met sterke AI-prestaties en efficiënte verwerkingsmogelijkheden. Toch blijft de H100 de beste keuze voor organisaties die de hoogste rekenkracht voor AI-toepassingen nodig hebben.

| Kenmerk | NVIDIA H100 | NVIDIA H800 | NVIDIA A100 |

|---|---|---|---|

| Architectuur | Hopper | Hopper | Ampere |

| Productietechnologie | 4nm TSMC | 4nm TSMC | 7nm TSMC |

| GPU-geheugen | 80GB HBM3 | 80GB HBM3 | 40GB/80GB HBM2e |

| Geheugenbandbreedte | Tot 3,35 TB/s (SXM) | ~1.9 TB/s (SXM) | Tot 2,0 TB/s (80GB-versie) |

| NVLink-bandbreedte | 900 GB/s | 400 GB/s | 600 GB/s |

| PCIe-generatie | PCIe 5.0 | PCIe 4.0 | PCIe 4.0 |

| Prestaties | Hoogste AI-training en inferentieprestaties | Verminderde prestaties door lagere NVLink-bandbreedte | Sterke prestaties voor AI-training en HPC |

| Marktbeschikbaarheid | Wereldwijd (Enterprise AI, HPC) | Beperkt tot China | Wereldwijd |

| Beste gebruiksscenario | Grote AI-modellen, LLM-training, high-performance AI | Kosteneffectieve AI voor Chinese bedrijven | AI-training, deep learning, HPC-werkbelastingen |

Bespaar tot 70% bij de aankoop van een gereviseerde NVIDIA A100 GPU van Renewtech

De NVIDIA A100 Tensor Core GPU is ontworpen voor AI-training, deep learning en inferentie. Het biedt hoge bandbreedteprestaties voor veeleisende AI-workloads tegen een fractie van de kosten van nieuwere modellen.

AI-servers die NVIDIA A100 ondersteunen

Het kiezen van de juiste AI-server is essentieel voor schaalbaarheid, efficiëntie en kosteneffectiviteit. AI-workloads, zoals deep learning, grote taalmodellen (LLM's) en real-time inferentie, vereisen krachtige hardware om de prestaties te maximaliseren zonder onnodige kosten.

Voor bedrijven die AI betaalbaar willen opschalen, bieden gereviseerde NVIDIA A100 GPU’s hoge rekenkracht tegen een fractie van de prijs. Om de keuze eenvoudiger te maken, hebben we twee krachtige AI-servers geselecteerd die volledig compatibel zijn met NVIDIA A100 GPU’s en de juiste balans bieden tussen snelheid, betrouwbaarheid en kostenefficiëntie.

Waarom het kiezen van de juiste AI-server belangrijk is

- Geoptimaliseerde workloads – AI-training, inferentie en deep learning vereisen krachtige GPU's, geheugen en PCIe-bandbreedte voor een soepele werking.

- Schaalbaarheid en toekomstbestendigheid – Een goed gekozen server zorgt voor een probleemloze uitbreiding naarmate de AI-behoeften groeien.

- Kostenefficiëntie – Investeren in de juiste hardware maximaliseert het rendement op investering en minimaliseert verspilde middelen.

Met door NVIDIA A100 aangedreven AI-servers kunnen bedrijven AI-infrastructuur opbouwen die sterke prestaties levert en binnen budget blijft.

Supermicro SYS-4028GR-TRT vs. Dell PowerEdge R740 voor AI

Het kiezen van de juiste AI-server is cruciaal om de prestaties en efficiëntie te maximaliseren. Zowel de Supermicro SYS-4028GR-TRT als de Dell PowerEdge R740 ondersteunen NVIDIA A100 GPU’s, maar ze bedienen verschillende AI-workloads.

- De Supermicro SYS-4028GR-TRT is ontworpen voor deep learning op grote schaal en ondersteunt tot 4 NVIDIA A100 GPU’s, waardoor het de beste keuze is voor bedrijven die een hoge GPU-dichtheid nodig hebben.

- De Dell PowerEdge R740 daarentegen ondersteunt maximaal 2 A100 GPU’s, waardoor het een kosteneffectief alternatief is voor bedrijven die zich richten op AI-inferentie en kleinschaligere training.

Hieronder een vergelijking om te bepalen welke AI-server het beste past bij uw GPU-infrastructuur.

| Kenmerk | Supermicro SYS-4028GR-TRT | Dell PowerEdge R740 |

| GPU-ondersteuning | Tot 4x NVIDIA A100 PCIe – Geoptimaliseerd voor multi-GPU AI-workloads. | Tot 2x NVIDIA A100 PCIe – Ontworpen voor AI-versnelling met kostenbesparing. |

| CPU-opties | Intel Xeon Scalable (2e generatie) – Dual-socket ondersteuning voor krachtige AI. | Intel Xeon Scalable (2e generatie) – Goed uitgebalanceerd voor inferentie-workloads. |

| Geheugencapaciteit | Tot 6TB DDR4 – Geschikt voor grootschalige AI-modellen en deep learning. | Tot 3TB DDR4 – Ondersteunt AI-workloads, maar met lagere schaalbaarheid. |

| Opslagcapaciteiten | Ondersteunt tot 24x 2,5” schijven (HDD/SSD) – Ontworpen voor data-intensieve AI-training. | Ondersteunt tot 16x 2,5” schijven (HDD/SSD) – Voldoende voor inferentie-toepassingen. |

| Netwerk en connectiviteit | Meerdere 10GbE- en 25GbE-opties, PCIe 4.0 voor AI-workloads met hoge bandbreedte. | Twee 10GbE-poorten, PCIe 4.0, geschikt voor efficiënte AI-inferentie. |

| Uitbreiding en schaalbaarheid | Meer PCIe Gen 4-slots – Ideaal voor multi-GPU-opstellingen en toekomstige uitbreiding. | Sterke PCIe 4.0-ondersteuning – Geschikt voor AI-workloads, maar beperkte multi-GPU schaalbaarheid. |

| Koeling en stroomverbruik | Geoptimaliseerd voor GPU’s met hoge dichtheid – Geavanceerde koeling om meerdere A100’s efficiënt te verwerken. | Efficiënt thermisch beheer – Energiezuinige koeling voor inferentie-workloads. |

| Vormfactor en dichtheid | 4U Rack Server – Hogere dichtheid, ontworpen voor grootschalige AI-modeltraining. | 2U Rack Server – Ruimtebesparend met gematigde AI-versnellingscapaciteiten. |

| Gebruiksscenario | AI-modeltraining, deep learning en LLM’s – Ideaal voor AI-onderzoek en productie. | AI-inferentie, kostenefficiënte AI-implementaties – Geoptimaliseerd voor bedrijven die AI op een efficiënte manier opschalen. |

Supermicro SYS-4028GR-TRT

Een AI-server met hoge dichtheid, ontworpen voor multi-GPU computing, de Supermicro SYS-4028GR-TRT is geoptimaliseerd om de prestaties van NVIDIA A100 te maximaliseren. Met voldoende PCIe 4.0-lanes, robuuste energie-efficiëntie en geavanceerde koeling zorgt deze server voor stabiele AI-training en inferentie-workloads.

- Geoptimaliseerd voor AI en machine learning – Ondersteunt multi-GPU-configuraties, ideaal voor deep learning en grote AI-modellen.

- Enterprise-prestaties – Hoge bandbreedte en efficiënte koeling om intensieve AI-berekeningen te verwerken.

Ontgrendel AI-prestaties met de Supermicro SYS-4028GR-TRT

Dell PowerEdge R740

Een veelzijdige enterprise-server, de Dell PowerEdge R740 biedt een schaalbare oplossing voor AI- en HPC-workloads. Met ondersteuning voor meerdere NVIDIA A100 GPU’s biedt het hoge geheugencapaciteit, efficiënte koeling en sterke PCIe 4.0-prestaties.

- Schaalbare AI-infrastructuur – Configureerbaar voor AI-modeltraining, inferentie en high-performance computing.

- Kosteneffectieve prestaties – Een gereviseerde R740 stelt bedrijven in staat AI te integreren zonder overbodige uitgaven, waardoor hoge prestaties behouden blijven tegen lagere kosten.

Ontgrendel AI-prestaties met de PowerEdge R740

AI-prestaties maximaliseren met H100-servers

Voor bedrijven die meer rekenkracht nodig hebben voor geavanceerde AI-toepassingen, biedt een upgrade naar NVIDIA H100 GPU’s een van de hoogste niveaus van AI-prestaties die beschikbaar zijn. Of het nu gaat om grootschalige deep learning, LLM-training of real-time AI-inferentie, de juiste serverinfrastructuur is cruciaal.

In tegenstelling tot eerdere GPU-generaties bieden H100 GPU’s:

- Ongeëvenaarde AI-versnelling – Snellere matrixbewerkingen, verhoogde NVLink-bandbreedte en verbeterde geheugenefficiëntie.

- Toekomstbestendige schaalbaarheid – Geoptimaliseerd voor AI-training, HPC en enterprise-workloads met PCIe 5.0-ondersteuning.

Bedrijven die grote AI-datasets verwerken, grootschalige simulaties uitvoeren of geavanceerde modeloptimalisatie nodig hebben, profiteren het meest van H100-ready AI-servers. Deze servers zijn ontworpen voor AI-workloads met hoge bandbreedte, waardoor snellere trainingstijden, real-time inferentie en naadloze schaalbaarheid voor toekomstige AI-projecten mogelijk worden.

Met gereviseerde AI-servers kunnen bedrijven H100 GPU’s integreren tegen lagere kosten, waardoor onnodige infrastructuuruitgaven worden vermeden terwijl ze toch profiteren van eersteklas AI-prestaties.

Hieronder hebben we twee krachtige AI-servers geselecteerd die volledig compatibel zijn met NVIDIA H100 GPU’s, zodat bedrijven de rekenkracht hebben die ze nodig hebben zonder te veel uit te geven.

Dell R750 vs. Lenovo SR650 V2 voor AI

Het kiezen van de juiste server voor AI en deep learning is cruciaal om prestaties en efficiëntie te maximaliseren. Zowel de Dell PowerEdge R750 als de Lenovo ThinkSystem SR650 V2 ondersteunen NVIDIA H100 GPU’s, maar ze zijn gericht op iets verschillende behoeften. De R750 biedt meer PCIe-slots voor betere uitbreidingsmogelijkheden, terwijl de SR650 V2 zich richt op schaalbaarheid en kostenefficiëntie. Hieronder vindt u een vergelijking om te bepalen welke het beste past bij uw AI-infrastructuur.

| Kenmerk | Dell PowerEdge R750 | Lenovo ThinkSystem SR650 V2 |

| GPU-ondersteuning | Tot 2x NVIDIA H100 PCIe | Tot 2x NVIDIA H100 PCIe |

| CPU-opties | Intel Xeon Scalable (3e generatie) | Intel Xeon Scalable (3e generatie) |

| Geheugencapaciteit | Ondersteunt tot 8TB DDR4/DDR5 | Ondersteunt tot 8TB DDR4/DDR5 |

| Opslagcapaciteiten | Ondersteunt tot 28x 2,5” schijven (HDD/SSD) | Ondersteunt tot 20x 2,5” schijven (HDD/SSD) |

| Netwerk en connectiviteit | Dubbele 10GbE-poorten, PCIe Gen 5-slots voor toekomstbestendigheid | Dubbele 10GbE-poorten, PCIe Gen 4, sterke energie-efficiëntie |

| Uitbreiding en schaalbaarheid | Meer PCIe Gen 4/5-slots – Ideaal voor multi-GPU-configuraties en AI-versnellers zoals NVIDIA NVLink Bridges. | Energy-efficient design with Lenovo Neptune™ cooling – Focuses on cost savings while maintaining AI performance. |

| Koeling en stroomverbruik | Geoptimaliseerd voor AI-workloads met hoge prestaties – Bevat Dell Smart Cooling voor krachtige GPU’s zoals de H100. | Efficiënt koelings- en stroombeheer – Gebruikt Lenovo XClarity Controller om stroomverbruik in AI-toepassingen te optimaliseren. |

| Vormfactor en dichtheid | 2U Rack Server – Hogere dichtheid voor enterprise AI | 2U Rack Server – Ontworpen voor schaalbaarheid en modulaire AI-uitbreiding |

| Gebruiksscenario | Enterprise AI en high-performance computing | Schaalbare AI-infrastructuur en kostenefficiënte AI-implementatie |

Dell PowerEdge R750

Een krachtige enterprise-server ontworpen voor AI-versnelling, de PowerEdge R750 ondersteunt tot twee NVIDIA H100 PCIe GPU’s. Met PCIe Gen 4-lanes en hoogwaardige netwerkmogelijkheden levert deze server de kracht die nodig is voor AI-modeltraining, inferentie en data-intensieve toepassingen.

- Geoptimaliseerd voor AI en machine learning – Ondersteunt configuraties met twee GPU’s, waardoor AI-workloads en real-time inferentie worden versneld.

- Enterprise-prestaties – Biedt hoge bandbreedte en efficiënt energiebeheer, waardoor het een sterke keuze is voor AI-gedreven bedrijven en ondernemingen.

Ontgrendel AI-prestaties met de PowerEdge R750

Lenovo ThinkSystem SR650 V2

Deze veelzijdige rackserver is ontworpen voor bedrijven die schaalbaarheid nodig hebben. Met ondersteuning voor full-length, full-height, double-wide GPU’s, waaronder de NVIDIA H100, is deze server geoptimaliseerd voor AI-workloads die snelle verwerking, deep learning en big data-analyse vereisen.

- Toekomstbestendige AI-infrastructuur – Ontworpen voor schaalbare AI-implementaties, waardoor uitbreiding soepel verloopt naarmate de AI-behoeften groeien.

- Kosteneffectieve prestaties – Een gereviseerde SR650 V2 stelt bedrijven in staat AI-infrastructuur te integreren tegen een aanzienlijk lagere prijs, waardoor high-performance AI toegankelijker wordt.

Ontgrendel AI-prestaties met de SR650 V2

Hulp nodig bij het kiezen van de juiste AI-server?

Het kiezen van de juiste AI-server hoeft niet moeilijk te zijn. Of u nu gereviseerde NVIDIA A100- of H100-GPU’s nodig heeft of deskundig advies zoekt, wij staan klaar om te helpen.

Hoe wij kunnen helpen:

✔ Persoonlijke AI-serverbegeleiding – Vind de beste oplossing voor uw AI-modeltraining of deep learning-behoeften.

✔ Voorraad- en beschikbaarheidsmeldingen – Ontvang een melding wanneer gereviseerde A100- of H100-GPU’s weer op voorraad zijn of ontdek alternatieve oplossingen.

Bespaar tot 70% op AI-infrastructuur – zonder concessies te doen aan prestaties

Heeft u kosteneffectieve AI-training nodig met A100/V100 of krachtige H100-GPU’s? Neem nu contact met ons op voor deskundig advies, prijzen en beschikbaarheid.